MATHEMATIQUES:

Etude maths (A Pr: Mohamedbahjet Sliman )Cours p...: Etude maths (A P r: Mohamedbahjet Sliman ) Cours particulier en MATH Profil du prof : Ancien étudiant à l

MATHEMATIQUES

Art et Sciences Mathématiques[by : sliman mohamedbahjet ] Les mathématiques constituent un domaine de connaissances abstraites construites à l'aide de raisonnements logiques sur des concepts tels que les nombres, les figures, les structures et les transformations... Les mathématiques et l'art entretiennent une longue relation historique. Le nombre d'or étant connu des Égyptiens et des Grecs, utilisé dans la construction de monuments, dont les pyramides, le Parthénon et le Colisée.

lundi 15 juin 2015

jeudi 20 novembre 2014

Etude maths

(A Pr: Mohamedbahjet Sliman )

Cours particulier en MATH

Profil du prof:

- Ancien étudiant à l' IPEST ... expérience plus que 15 ans dans le domaine.

|

| Etude Spirit Maths |

1. On donne :

des séances de rattrapage.

Résumé de cour

Séries des exercices.

Méthodes de résolution simple et efficace.

2. Pour tous les niveaux et toutes les sections :

- 7em _ 8em _ 9em

- 1er _ 2em (tous les sections) _ 3em (tous les sections) _ 4em [BAC](tous sections)( En particulier : les élèves de BAC révision de tout le programme pour le concours )

- Prépa : 1er _ 2em (tous les sections)

- fac : 1er 2 em 3em 4em (tous les sections)

3. Pour plus d'ample information veuillez contacter :

21123699

mardi 2 septembre 2014

samedi 24 mai 2014

Coniques

Mr : Sliman Mohamed Bahjet

- Les coniques forment une famille de courbes planes résultant de l'intersection d'un plan avec un cône de révolution. Dans la suite toutefois, on omettra le plus souvent de la définition des coniques, les cas où le cône est lui-même dégénéré

- Ce qui survient si : l'angle d'ouverture du cône est maximal (angle au sommet égal à 180 °), auquel cas le cône se réduit à un seul plan, dont l'intersection avec un autre plan peut être soit vide, soit le même plan, soit le plus souvent une droite ; l'angle d'ouverture du cône est minimal (angle au sommet égal à 0 °), auquel cas le cône se réduit à une seule droite, dont l'intersection avec un autre plan peut être soit vide, soit la même droite, soit le plus souvent un simple point. Selon les positions relatives du plan de coupe et du cône (non dégénéré selon la définition ci-dessus), on obtient différents types de coniques : Intersection d'un plan et d'un cône de révolution Les coniques propres, quand le plan de coupe ne passe pas par le sommet du cône. On distingue trois sortes de coniques propres en fonction de l'angle d’inclinaison du plan de coupe avec l’axe du cône : si cet angle d'inclinaison est inférieur à l'angle d'ouverture, l'intersection est une hyperbole ; dans le cas particulier où l'angle d'inclinaison est inférieur d'exactement 45° à l'angle d'ouverture du cône, cet hyperbole est même équilatère (ce cas particulier n'existe pas si l'angle d'ouverture du cône n’est pas lui-même d’au minimum 45°, c'est-à-dire si le cône est aigu ; si l’angle d’ouverture du cône est exactement 45°, le plan de coupe doit être parallèle à l'axe du cône pour que l'intersection soit une hyperbole équilatère) ; si cet angle d'inclinaison est égal à l'angle d'ouverture du cône, l'intersection est une parabole ; si cet angle d'inclinaison est supérieur à l'angle d'ouverture du cône, l'intersection est une ellipse (cette ellipse est une des courbes directrices du cône) ; dans le cas maximal où l'angle d'inclinaison du plan de coupe est droit, cette ellipse est même un cercle (lui aussi une des courbes directrices du cône). Les coniques dégénérées (en), quand le plan contient le sommet du cône.

- Là encore, on distingue trois sortes de coniques dégénérées en fonction de l'angle d’inclinaison du plan de coupe avec l’axe du cône : si cet angle d'inclinaison est inférieur à l'angle d'ouverture du cône, l'intersection est réduite à un couple de droites sécantes (deux génératrices du cône, passant toutes deux par le sommet du cône). si cet angle d'inclinaison est égal à l'angle d'ouverture du cône, l'intersection est réduite à une seule droite (une des génératrices du cône passant par le sommet du cône, et où le plan de coupe et le cône sont tangents) ; si cet angle d'inclinaison est supérieur à l'angle d'ouverture du cône, l'intersection est réduite à un seul point (le sommet du cône).

- Les célèbres coniques (ellipse, parabole, hyperbole) étudiées par les mathématiciens grecs de l'antiquité (Apollonis de Perge, Menechme, Pappus) peuvent être définies au moyen d'un point appelé foyer (Kepler) et d'une droite (d) dite directrice (Pappus).Ainsi, une conique est l'ensemble des points M tels que MF/MH = e où H désigne la projection orthogonale de M sur (d) et e un nombre strictement positif donné. Ce nombre e est appelé excentricité de la conique.La droite perpendiculaire à (d) passant par F est l'axe focal : il s'agit ici de la droite (KF), K désignant la projection orthogonale de F sur (d).Cette définition permet d'affirmer que (FK) est un axe de symétrie de la conique. Le point S de (FK) vérifiant SF/SK = e est dit sommet de la conique. Lorsque e est distinct de 1, il existe deux points S et S' divisant [KF] dans le rapport e : c'est dire que la conique admet un second sommet S'.Lorsque e est distinct de 1, un calcul analytique (voir ci-dessous) permet d'observer une symétrie et, par suite, l'existence d'un second foyer F' et d'une seconde directrice : l'ellipse (e < 1) et l'hyperbole (e > 1) sont des coniques bifocales, dites aussi coniques à centre. Le centre est le milieu de [FF'].

- La définition actuelle d’une conique est d’être une courbe algébrique du deuxième degré.

- Cette définition englobe les cas de dégénérescence (dans le plan euclidien : ensemble vide, point, réunion de deux droites) et permet d’affirmer que les coniques sont les sections planes de quadriques.

- Cependant, dans ce site, le mot conique désigne uniquement les cas non dégénérés, ou "propres" : ellipse, parabole, hyperbole.

- Avec cette acception, voici diverses définitions géométriques des coniques :

- 1) Définition des Grecs.

- Les coniques sont les sections d’un cône de révolution par un plan ne passant pas par son sommet.

- Ellipse

- Parabole

- Hyperbole

- 2) Définition par foyer et directrice.

- Les coniques sont des cercles, ou les lieux des points dont le rapport des distances à un point fixe (le foyer F) et à une droite fixe (la directrice (D)) est constant (égal à l’excentricité e) ; les ellipses sont obtenues pour e < 1, la parabole pour e = 1, les hyperboles pour e > 1.

- Ce n'est qu'en 1822 que Dandelin a relié entre elles ces deux premières définitions, en montrant que les foyers et les directrices sont obtenus à l'aide des deux sphères inscrites :

- 3) Définition par courbe d'équidistance entre un point et un cercle généralisé.

- Les coniques sont les lieux des points équidistants d’un point fixe (le foyer) et d’un cercle ou d'une droite (C) (le cercle directeur ou la directrice), c'est à dire les isotèles de cercle généralisé ; autrement dit, ce sont les lieux du centre d’un cercle variable astreint à passer par un point fixe et à être tangent à (C).

- Lorsque le foyer est intérieur au cercle, on obtient les ellipses, extérieur les hyperboles, et lorsque (C) est une droite : la parabole.

- Plus généralement, les lieux des centres de cercles tangents à deux cercles généralisés de rayons distincts sont des réunions de deux coniques.

- 4) Définition par orthocaustique de cercle ou droite.

- Les coniques sont les orthocaustiques (ou antipodaires) d’un cercle ou d'une droite (C') (le cercle principal ou la tangente au sommet).

- Lorsque la source lumineuse, qui est aussi le foyer de la conique, est intérieure au cercle, on obtient les ellipses, extérieure, les hyperboles, et lorsque (C') est une droite : la parabole.

- Les coniques sont donc aussi les enveloppes de la médiatrice d'un segment joignant un point à un cercle ou une droite (le cercle directeur ou la directrice) (autrement dit, ce sont les courbes dont l’orthotomique est un cercle ou une droite).

- 5) les coniques sont les anticaustiques de droite.

- La première définition a plusieurs implications dans la vie courante : par exemple le bord de la trace lumineuse que fait une lampe à abat-jour ou une lampe de poche sur un mur est une conique

- La définition par foyer et directrice permet de retrouver les relations fondamentales de la définition bifocale

MF + MF' = 2a

(ellipse)

et

| MF' - MF | = 2a (hyperbole).

- En effet, dans le cas de l'ellipse, on a : MF = eMH et MF' = eMH',

donc MF + MF' = e(MH + MH') = e 2a²/c. Or e = c/a, d'où le résultat. Le cas de l'hyperbole s'obtient de la même manière en remarquant que les directrices coupent l'axe focal entre S et S' (puisque e = c/a > 1).

Ellipse

- L'ensemble de tels points fut étudié géométriquement (indépendamment de l'aspect analytique décrit ci-dessus) par La Hire au 17è siècle.Résumé des principales caractéristiques de l'ellipse et de l'hyperbole (équations réduites) :

- Ellipse

x²/a² + y²/b² = 1

- Abscisses foyer :

c²= a² - b² (a > b) , c² = b² - a² (a < b)

- Excentricité : e = c/a

- Directrices : x = ± a²/c (a > b) , x = ± b²/c (a < b)

- Tangentes en M(xo,yo) : xxo/a² + yyo/b² = 1

- Hyperbole

x²/a² - y²/b² = ±1 = ε

- Abscisses foyer : c² = a² + b² Excentricité : e = c/a (ε =1) , e = c/b (ε =-1) Directrices : x = ± a²/c (ε =1) , y = ± b²/c (ε= -1)

- Asymptotes : ay = ± bx

- Tangentes en M(xo,yo) : xxo/a² - yyo/b² = ±1

Parabole

HYPERBOLE

vendredi 23 mai 2014

Variables aléatoires

Mr Sliman Mohamedbahjet :

Variables aléatoires

http://

• Variables aléatoires sur un ensemble fini:

Soit (Ω, P (Ω) , P) un espace probabilisé fini. Une variable aléatoire

Soit (Ω, P (Ω) , P) un espace probabilisé fini. Une variable aléatoireest une application de Ω dans R

• Pour tout x ∈ IR, l’événement

X¹ (x) = {ω; ω∈ Ω, X (ω) = x}

• Déterminer la loi de probabilité de X, c’est déterminer X (Ω),

et, pour chaque xi ∈ X (Ω), déterminer la probabilité P (X = xi).

• Réciproquement, soit {(xi, pi) ; i ∈ I} un ensemble fini de couples

de nombres réels. Pour vérifier que cet ensemble est la loi de probabilité

d’une v.a finie X, avec P(X = xi) = pi, il suffit de vérifier :

− ∀i ∈ I, 1 > pi ≥ 0 ;

− pour i∈I ; somme des ∑ pi = 1.

• Propriétés:

• Si les v.a X1, · · · , Xn sont indépendantes, alors elles sont indépendantes deux à deux. La réciproque est fausse.• Si X1, · · · , Xn sont indépendantes, alors toute fonction de X1, · · · , Xp

est indépendante de toute fonction de Xp+1, · · · , Xn, 1 p < n. En

particulier, si X, Y sont indépendantes,alors toute fonction de X est

indépendante de toute fonction de Y.

• Espérance, ou moyenne:

• Définition:

Soit X une v.a définie sur V fini. L’espérance, ou moyenne, de X est le nombre réel noté E (X) et défini par:E (X) = ∑ xi P (X = xi) ; xi∈X(Ω)

Cette définition est à rapprocher de la définition de la moyenned’une série statistique : la fréquence de la valeur observée xi de la

variable statistique X est remplacée par la probabilité de la valeur xi pour la v.a X.

Linéarité de l’espérance:

Soit X et Y deux v.a définies sur V fini et a, b deux nombres réels.

Alors:

E (X + Y) = E (X) + E(Y)

E (aX + b) = aE (X) + b

Théorème de transfert:

Soit X une v.a définie sur V fini, et w une application définie sur

X (V). Alors :

E (ф (X)) = ∑ ф (xi) P (X = xi) ;xi∈X(Ω)

• Variance, écart-type:Définitions:

• soit X une v.a définie sur V fini. La variance de X est le nombre réel noté V(X) et défini par :V(X) = ∑ [xi − E (X)]²P (X = xi) ; xi∈X(Ω)

V(X) = E[X − E (X)]²

• L’écart-type σ (X) est la racine carrée de la variance :

σ (X) = √(V(X))

Exo1:

On lance 4 dés, et on note S la somme des résultats obtenus. Calculer E(S).

Sol:

Soient X1, X2, X3 et X4 les résultats obtenus pour chaque dé.

On a :

E(X1) = E(X2) = E(X3) =E(X4)

E(X1) = (1 + 2 + 3 + 4 + 5 + 6) = 3,5

Or, S = X1 + X2 + X3 + X4,

d'où :

E(S) = E(X1 + X2 + X3 + X4) = 4E(X1) = 4 * 3,5 = 14

Exo2:

On lance deux fois de suite un dé équilibré. Modéliser cette expérience. Soit X la variable aléatoire égale au plus grand des numéros tirés. Quelle est la loi de probabilité de X. Calculer son espérance mathématique et sa variance.

Sol:

Modélisation:

L'ensemble des résultats élémentaires pour le jet d'un dé est {1, 2, 3, 4, 5, 6}.

L'ensemble des résultats élémentaires pour deux jets d'un dé est W = {1, 2, 3, 4, 5, 6} ².

Son cardinal est Card (W) = 6 ² = 36.

Comme le dé est équilibré, chaque résultat élémentaire d'un jet du dé est équiprobable et a une probabilité .

Comme les jets sont supposés indépendants, les probabilités se multiplient ; chaque élément de W est équiprobable et a une probabilité .

https://fbcdn-sphotos-h-a.akamaihd.net/hphotos-ak-prn2/t1.0-9/1461859_4277237627234_3877567632357777698_n.jpg

https://www.facebook.com/mohamebbahjet.sliman

Sol:

Modélisation:

L'ensemble des résultats élémentaires pour le jet d'un dé est {1, 2, 3, 4, 5, 6}.

L'ensemble des résultats élémentaires pour deux jets d'un dé est W = {1, 2, 3, 4, 5, 6} ².

Son cardinal est Card (W) = 6 ² = 36.

Comme le dé est équilibré, chaque résultat élémentaire d'un jet du dé est équiprobable et a une probabilité .

Comme les jets sont supposés indépendants, les probabilités se multiplient ; chaque élément de W est équiprobable et a une probabilité .

https://fbcdn-sphotos-h-a.akamaihd.net/hphotos-ak-prn2/t1.0-9/1461859_4277237627234_3877567632357777698_n.jpg

https://www.facebook.com/mohamebbahjet.sliman

mercredi 27 février 2013

The Fourier transform

The Fourier transform takes an input function f (in red) in the “time domain” and converts it into a new function f-hat (in blue) in the “frequency domain”.In other words, the original function can be thought of as being “amplitude given time”, and the Fourier transform of the function is “amplitude given frequency”.Shown here, a simple 6-component approximation of the square wave is decomposed (exactly, for simplicity) into 6 sine waves. These component frequencies show as very sharp peaks in the frequency domain of the function, shown as the blue graph. In practice, these peaks are never that sharp. That would require infinite precision.I’m not too happy with this one yet. I might add a few frames to smooth a few steps out.

samedi 16 février 2013

Dans tout ce chapitre :

I. Ensembles dénombrables

Définition :

Un ensemble

Il est dit au plus dénombrable ssi il est équipotent à une partie de

Deux ensembles

Deux ensembles  Si

Si Exemples :

1) Soit

Les applications

Donc

2) Tout ensemble fini est au plus dénombrable car il est équipotent à une partie de

Remarque :

Si

Théorème :

Soit

Soit

Soit Alors

Corollaire :

Soit

Alors

Proposition :

Soit

S'il existe une application injective

S'il existe une application injective  S'il existe une application surjective

S'il existe une application surjective Soit

f est injective par unicité de la décomposition d'un entier en produit de facteurs premiers.

Théorème :

Toute réunion d'une suite d'ensembles dénombrables est un ensemble dénombrable.

Toute réunion d'une suite d'ensembles au plus dénombrables est un ensemble au plus dénombrable.

Théorème :

Soit

Il existe une suite

Il existe une suite On a :

II. Familles sommables de réels positifs

Définition :

Soit

On dit que

Dans ce cas, la borne supérieure de cet ensemble est appelée la somme de la famille

Ainsi :

Exemples :

Exemple 1 : Soit

Soit

En effet, soit

Soit

On a

On a :

On conclut :

Soit maintenant

Posons :

Donc :

Montrons que :

Soit

Alors :

Posons donc :

C'est-à-dire :

Donc :

Exemple 2 :

Soit

On a :

Donc :

Donc

Remarques :

1) Soit

Si

D'où

En particulier :

Réciproquement, si la famille est nulle, elle est sommable de somme 0.

Conclusion :

2) Toute sous famille d'une famille de réels positifs sommable est elle-même sommable de somme plus petite.

Théorème :

Soit

Si

Si  Si

Si Exemple 1 :

Pour tout

D'où :

Comme

Exemple 2 :

On a :

On en déduit que :

Proposition :

Soit

Théorème :

Soit

Soit

La suite réelle

La suite réelle  La suite réelle

La suite réelle De plus, dans ce cas :

Soit

Or,

Donc :

En outre dans ce cas :

Soit :

Alors :

La fonction

Rappel :

On dit que

Proposition :

Soit

Alors

De plus, dans ce cas :

Proposition :

Soit

Alors

De plus, dans ce cas :

Corollaire :

Soit

On a alors :

III. Famille sommable d'éléments de K (cas général)

1. Sommabilité

Définition :

Soit

On dit que

1)

2)

On a :

Remarques :

Toute famille finie d'éléments de

Toute famille finie d'éléments de  Toute famille presque nulle d'éléments de

Toute famille presque nulle d'éléments de  Toute sous famille d'une famille sommable d'éléments de

Toute sous famille d'une famille sommable d'éléments de

Proposition :

Soit

Si

Si  Si

Si On note

Proposition :

Soit

Alors

2. Somme d'une famille sommable

Théorème - Définition :

Soit

La suite

La suite  La limite de cette suite ne dépend pas du choix de

La limite de cette suite ne dépend pas du choix de En général :

La réciproque est fausse en général .

Contre-exemple :

Soit

Or,

Donc

Proposition :

Soit

Proposition :

Soit

Si

Si

Proposition :

Soit

Théorème :

Soit

Alors :

De plus, dans ce cas :

Théorème :

Soit

De plus, dans ce cas :

Proposition :

Soit

Alors

De plus, dans ce cas :

Corollaire :

Soit

De plus, dans ce cas :

IV. Suites doubles sommables

Théorème :

Soit

Alors la suite double

Théorème : "d'interversion des sommations"

Soit

De plus, dans ce cas :

Théorème de "Fubini" :

Soit

La réciproque du théorème de Fubini est fausse en général.

Exemple :

Soient

On a :

On sait que :

Donc

Donc :

Si

Si On a :

Si

Si Contre-exemple :

Considérons la famille

Il est clair que pour

On a

Soit

Mais on a

V. Groupements de termes

Les séries envisagées dans ce paragraphe sont à termes dans un evn

Définitions générales :

Soient

On dit que la série

Les

Proposition :

Si

La réciproque de cette proposition est fausse en général.

La réciproque de cette proposition est fausse en général.  Cette proposition n'est pas pratique car elle suppose que

Cette proposition n'est pas pratique car elle suppose que

Théorème : "de groupement de termes" :

Avec les notations précédentes :

Si

Si la longueur des paquets n'est pas bornée, il se peut que

Exemple :

Et

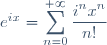

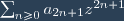

Prérequis : Suites et séries de fonctions.

I. Définitions

.

.

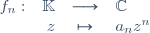

Étant donné une suite

Étant donné une suite _{n%20\in%20\mathbb{N}}) de nombres complexes, on lui associe la série de fonctions

de nombres complexes, on lui associe la série de fonctions  où :

où :

est dite la série entière associée à

est dite la série entière associée à _{n%20\in%20\mathbb{N}}) dont elle est appelée la suite des coefficients.

dont elle est appelée la suite des coefficients.

est dite série entière de la variable réelle si

est dite série entière de la variable réelle si  , et de la variable complexe si

, et de la variable complexe si  .

.

Une série entière de coefficients ) se note généralement :

se note généralement :  ou

ou  .

.

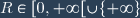

II. Convergence d'une série entière

1. Rayon de convergence

Lemme d'Abel :

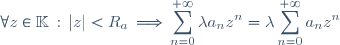

Soit  une série entière et

une série entière et  tq

tq _n) est bornée.

est bornée.

Alors, pour tout  on a :

on a :  entraîne

entraîne  converge absolument.

Théorème - Définition :

Soit

converge absolument.

Théorème - Définition :

Soit  une série entière. Alors il existe un unique nombre noté

une série entière. Alors il existe un unique nombre noté  avec

avec  tq :

tq :

s'appelle le rayon de convergence de

s'appelle le rayon de convergence de  .

.

Exemple :

:

:

Pour ) ;

;  converge absolument.

converge absolument.

Pour ![|z| > 1 \, : \, \left|\displaystyle \frac{n}{n^2+1} z^n \right| = \displaystyle \frac{n}{n^2+1} |z|^n \xrightarrow[n\to+\infty]{} +\infty](http://latex.ilemaths.net/latex-1.tex?|z|%20%3E%201%20\,%20:%20\,%20\left|\displaystyle%20\frac{n}{n^2+1}%20z^n%20\right|%20=%20\displaystyle%20\frac{n}{n^2+1}%20|z|^n%20\xrightarrow[n\to+\infty]{}%20+\infty) ;

;  diverge.

diverge.

Donc

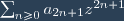

Proposition :

Soit  une série entière de rayon de convergence

une série entière de rayon de convergence  . Alors :

. Alors :

%20\text{%20born%E9e%20}%20\rbrace) .

.

.

.

.

.

![R = \sup_{\bar{\mathbb{R}}} \lbrace |z| / z \in \mathbb{K} \text{ et } a_nz^n \xrightarrow[n \to +\infty]{} 0 \rbrace](http://latex.ilemaths.net/latex-2.tex?R%20=%20\sup_{\bar{\mathbb{R}}}%20\lbrace%20%20|z|%20%20/%20z%20\in%20\mathbb{K}%20\text{%20et%20}%20a_nz^n%20\xrightarrow[n%20\to%20+\infty]{}%200%20\rbrace) .

.

%20\text{%20converge%20}%20\rbrace) .

.

Notation et vocabulaire :

Soit  une série entière de rayon de convergence

une série entière de rayon de convergence  . Alors

. Alors %20=%20\lbrace%20z%20\in%20\mathbb{K}%20/%20|z|%20%3C%20R%20\rbrace) est appelé le disque de convergence de

est appelé le disque de convergence de  .

.

En particulier, si  ,

, ![D(0,R) = ]-R , R[](http://latex.ilemaths.net/latex-1.tex?D(0,R)%20=%20]-R%20,%20R[) ; on l'appelle l'intervalle de convergence.

; on l'appelle l'intervalle de convergence.

Remarques :

1) Si  est la somme de la série entière

est la somme de la série entière  , alors :

, alors : %20\subset%20D_f%20\subset%20\overline{D(0%20,%20R)}) .

.

2) Si  :

:

converge

converge

converge.

converge.

Ou :

convergence absolument

convergence absolument

converge absolument.

converge absolument.

Alors : %20=%20R_{cv}%20\left(%20\displaystyle%20\sum_{n%20\geq%200}%20b_n%20z^n%20\right))

Proposition :

Soit  et

et  deux séries entières de rayon de convergence

deux séries entières de rayon de convergence  respectivement.

respectivement.

Si  , alors :

, alors :  .

Proposition :

Soit

.

Proposition :

Soit  et

et  deux séries entières de rayon de convergence

deux séries entières de rayon de convergence  respectivement.

respectivement.

S'il existe  tq :

tq :  , alors :

, alors :  .

Proposition :

Soit

.

Proposition :

Soit  une fonction rationnelle n'ayant pas de pôles entiers. Alors le rayon de convergence de

une fonction rationnelle n'ayant pas de pôles entiers. Alors le rayon de convergence de z^n) est égal à 1.

est égal à 1.

Remarque :

L'utilisation de la règle de D'Alembert est pratique surtout pour les séries entières dites lacunaires :

C'est-à-dire les séries de la forme }) tq

tq  une extractrice et :

une extractrice et : }%20=%20\displaystyle%20\sum_{n%20\geq%200}%20a_n%20z^n) avec

avec }%20=%20b%20\\%20a_k%20=%200%20\text{%20si%20}%20k%20\not%20\in%20\psi(\mathbb{N})}%20\end{array}%20\right%20.)

Exemple :

avec

avec  :

:

Pour  , on pose :

, on pose : %20=%20\displaystyle%20\frac{na^n}{2^n}%20z^{3n}) .

.

![\forall n \geq 1 \, : \, \left| \displaystyle \frac{b_{n+1}(z)}{b_n(z)} \right| = \left| \displaystyle \frac{n+1}{n} \frac{a}{2} z^3 \right| = \displaystyle \frac{n+1}{n} \frac{|a|}{2} |z|^3 \xrightarrow[n\to+\infty]{} \displaystyle \frac{|a|}{2} |z|^3](http://latex.ilemaths.net/latex-1.tex?\forall%20n%20\geq%201%20\,%20:%20\,%20\left|%20\displaystyle%20\frac{b_{n+1}(z)}{b_n(z)}%20\right|%20=%20\left|%20\displaystyle%20\frac{n+1}{n}%20\frac{a}{2}%20z^3%20\right|%20=%20\displaystyle%20\frac{n+1}{n}%20\frac{|a|}{2}%20|z|^3%20\xrightarrow[n\to+\infty]{}%20\displaystyle%20\frac{|a|}{2}%20|z|^3) .

.

Si

Si  (ie

(ie ^{\frac{1}{3}}) ) : donc

) : donc  converge absolument.

converge absolument.

Si

Si  (ie

(ie ^{\frac{1}{3}}) ) : alors

) : alors  diverge.

diverge.

On déduit que ^{\frac{1}{3}})

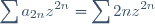

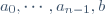

Proposition :

Soit  une série entière, soit

une série entière, soit  (resp.

(resp.  resp.

resp.  ) le rayon de convergence de

) le rayon de convergence de  (resp.

(resp.  et

et  ). Alors

). Alors ) .

.

De plus :  .

.

Exemple :  avec :

avec : ^n}) :

:

, donc

, donc  .

.

, donc

, donc  .

.

On en déduit que  .

.

Proposition :

Soit  une série entière de rayon de convergence

une série entière de rayon de convergence  , soit

, soit  une fonction rationnelle n'ayant pas de pôles dans

une fonction rationnelle n'ayant pas de pôles dans  .

.

Alors le rayon de convergence de %20a_n%20z^n) est égal à

est égal à  .

.

2. Convergence ponctuelle

Théorème :

Soit  une série entière de rayon de convergence

une série entière de rayon de convergence  .

.

Alors  converge normalement sur tout compact inclus dans

converge normalement sur tout compact inclus dans )

Remarque :

Il se peut qu'une série entière de rayon de convergence positif ne converge pas normalement sur le disque ) .

Corollaire :

La somme d'une série entière de rayon de convergence positif est continue sur le disque

.

Corollaire :

La somme d'une série entière de rayon de convergence positif est continue sur le disque ) .

.

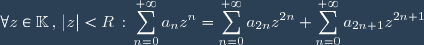

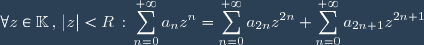

III. Opérations sur les séries entières

Soit

Soit  ,

,  deux séries entières de rayons de convergence

deux séries entières de rayons de convergence  et

et  respectivement.

respectivement.

Soit

Soit  .

.

On pose :

On pose :  ,

,  et

et  .

.

On note

On note  et

et  les rayons de convergence respectivement des séries entières :

les rayons de convergence respectivement des séries entières :  ,

,  et

et  .

.

i)

) .

.

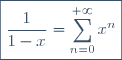

%20\,%20\Longrightarrow%20\,%20\displaystyle%20\sum_{n=0}^{+\infty}(a_n%20+%20b_n)z^n%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20z^n%20+%20%20\displaystyle%20\sum_{n=0}^{+\infty}%20b_n%20z^n) .

.

ii)

.

.

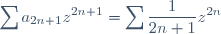

iii)

) .

.

%20\,%20\Longrightarrow%20\,%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\displaystyle%20\sum_{k=0}^n%20a_k%20b_{n-k}%20\right)z^n%20=%20\left(\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20z^n%20\right)%20\left(\displaystyle%20\sum_{n=0}^{+\infty}%20b_n%20z^n%20\right)) .

.

IV. Propriétés de la somme d'une série entière de la variable réelle

Ici,  est une série entière de la variable réelle dont le rayon de convergence

est une série entière de la variable réelle dont le rayon de convergence  est supposé positif et dont la somme est noté

est supposé positif et dont la somme est noté  .

.

est définie sur au moins

est définie sur au moins ![]-R , R[](http://latex.ilemaths.net/latex-1.tex?]-R%20,%20R[) , on rappelle que

, on rappelle que  est continue sur cet intervalle.

est continue sur cet intervalle.

Théorème :

La série entière  est de rayon de convergence

est de rayon de convergence

De plus, on a : ![\forall x \in ]-R,R[ \, : \, \displaystyle \sum_{n=0}^{+\infty} a_n \displaystyle \frac{x^{n+1}}{n+1} = \displaystyle \int_0^{x} f(t) \text{d}t](http://latex.ilemaths.net/latex-1.tex?\forall%20x%20\in%20]-R,R[%20\,%20:%20\,%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20\displaystyle%20\frac{x^{n+1}}{n+1}%20=%20\displaystyle%20\int_0^{x}%20f(t)%20\text{d}t) .

.

Remarque :

Soit ![p , q \in ]-R , R[ \, : \, \displaystyle \int_{p}^q f(t) \text{d}t = \displaystyle \int_{0}^q f(t) \text{d}t - \displaystyle \int_{0}^p f(t) \text{d}t](http://latex.ilemaths.net/latex-1.tex?p%20,%20q%20\in%20]-R%20,%20R[%20\,%20:%20\,%20\displaystyle%20\int_{p}^q%20f(t)%20\text{d}t%20=%20\displaystyle%20\int_{0}^q%20f(t)%20\text{d}t%20-%20\displaystyle%20\int_{0}^p%20f(t)%20\text{d}t) .

.

%20\text{d}t%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20\displaystyle%20\frac{q^{n+1}}{n+1}%20-%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20\displaystyle%20\frac{p^{n+1}}{n+1}%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20\displaystyle%20\frac{q^{n+1}-p^{n+1}}{n+1}%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\int_{p}^q%20a_n%20t^n%20\text{d}t) .

.

Autrement dit : %20\text{d}t%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\displaystyle%20\int_p^q%20a_n%20t^n%20\text{d}t\right)) .

.

On dit qu'une série entière s'intègre terme à terme entre deux points quelconques de son intervalle de convergence .

Théorème :

Pour tout

Pour tout  , la série entière

, la série entière !}%20x^{n-k}) a pour rayon de convergence

a pour rayon de convergence  .

.

est de classe

est de classe  sur

sur ![]-R , R[](http://latex.ilemaths.net/latex-2.tex?]-R%20,%20R[) et on a :

et on a : ![\forall k \in \mathbb{N} \, , \, \forall x \in ]-R , R[](http://latex.ilemaths.net/latex-2.tex?\forall%20k%20\in%20\mathbb{N}%20\,%20,%20\,%20\forall%20x%20\in%20]-R%20,%20R[) :

: }%20(x)%20=%20\displaystyle%20\sum_{n=k}^{+\infty}%20a_n%20\displaystyle%20\frac{n!}{(n-k)!}%20x^{n-k}) .

.

Exemple :

Soit %20=%20\displaystyle%20\sum_{n=2}^{+\infty}%20\displaystyle%20\frac{x^n}{n(n-1)}) .

.

On a :  ;

;  est donc définie et continue sur

est donc définie et continue sur ![]-1 , 1[](http://latex.ilemaths.net/latex-1.tex?]-1%20,%201[) .

.

) et

et ) existent, donc :

existent, donc : ![D_f = [-1 , 1]](http://latex.ilemaths.net/latex-1.tex?D_f%20=%20[-1%20,%201]) .

.

![\forall n \geq 2 \, , \, \forall x \in [-1,1] \, : \, \left| \displaystyle \frac{x^n}{n(n-1)} \right| \leq \displaystyle \frac{1}{n(n-1)} = \alpha_n](http://latex.ilemaths.net/latex-1.tex?\forall%20n%20\geq%202%20\,%20,%20\,%20\forall%20x%20\in%20[-1,1]%20\,%20:%20\,%20\left|%20\displaystyle%20\frac{x^n}{n(n-1)}%20\right|%20\leq%20\displaystyle%20\frac{1}{n(n-1)}%20=%20\alpha_n) .

.

converge, donc

converge, donc  est somme uniforme sur

est somme uniforme sur ![[-1 , 1]](http://latex.ilemaths.net/latex-1.tex?[-1%20,%201]) d'une série de fonctions continue sur

d'une série de fonctions continue sur ![[-1 , 1]](http://latex.ilemaths.net/latex-1.tex?[-1%20,%201]) , alors

, alors  est continue sur

est continue sur ![[-1,1]](http://latex.ilemaths.net/latex-1.tex?[-1,1]) .

.

est de classe

est de classe  sur

sur ![]-1,1[](http://latex.ilemaths.net/latex-1.tex?]-1,1[) :

:

%20=%20\displaystyle%20\sum_{n=2}^\infty%20\frac{x^{n-1}}{n-1}) et

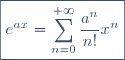

et %20=%20\displaystyle%20\sum_{n=2}^{+\infty}%20x^{n-2}%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20x^n%20=%20\displaystyle%20\frac{1}{1-x}) .

.

%20=%20\displaystyle%20\int_{0}^x%20f''(t)%20\text{d}t) (car

(car %20=%200) ).

).

Donc : %20=%20\displaystyle%20\int_{0}^x%20f''(t)%20\text{d}t%20=%20\displaystyle%20\int_{0}^x%20\displaystyle%20\frac{\text{d}t}{1-t}%20=%20-\ln(1-x)) .

.

et puisque %20=%200) ,

,

![f(x) = \displaystyle \int_{0}^x f'(t) \text{d}t = (1 - x) \ln(1 - x) + x \hspace{20pt} \forall x \in ]-1 , 1[](http://latex.ilemaths.net/latex-1.tex?f(x)%20=%20\displaystyle%20\int_{0}^x%20f'(t)%20\text{d}t%20=%20(1%20-%20x)%20\ln(1%20-%20x)%20+%20x%20\hspace{20pt}%20\forall%20x%20\in%20]-1%20,%201[) .

.

Donc : ![\boxed{f(x) = \displaystyle \sum_{n=2}^{+\infty} \displaystyle \frac{x^n}{n(n-1)} = (1 - x)\ln(1 - x) + x \hspace{20pt} \forall x \in ]-1 , 1[}](http://latex.ilemaths.net/latex-1.tex?\boxed{f(x)%20=%20\displaystyle%20\sum_{n=2}^{+\infty}%20\displaystyle%20\frac{x^n}{n(n-1)}%20=%20(1%20-%20x)\ln(1%20-%20x)%20+%20x%20\hspace{20pt}%20\forall%20x%20\in%20]-1%20,%201[}) .

.

Remarque :

On avait obtenu : ![\forall x \in ]-1 , 1[ \, : \, \displaystyle \sum_{n=2}^{+\infty} \displaystyle \frac{x^n}{n(n-1)} = (1-x)\ln(1-x) + x](http://latex.ilemaths.net/latex-1.tex?\forall%20x%20\in%20]-1%20,%201[%20\,%20:%20\,%20\displaystyle%20\sum_{n=2}^{+\infty}%20\displaystyle%20\frac{x^n}{n(n-1)}%20=%20(1-x)\ln(1-x)%20+%20x) .

.

Donc : %20=%20\displaystyle%20\lim_{n\to-1^+}%20f(x)%20=%202\ln%202%20-1) , on en déduit :

, on en déduit : ^n}{n(n-1)}%20=%202\ln2-1) .

.

Essayons de démontrer ce résultat directement en étudiant la somme partielle de la série :

Soit

^n}{n(n-1)}%20\\%20=%20\displaystyle%20\sum_{k=1}^{N}%20\displaystyle%20\frac{1}{2k(2k-1)}%20-%20\displaystyle%20\sum_{k=1}^{N}%20\frac{1}{2k(2k+1)}%20\\%20=%20\displaystyle%20\sum_{k=1}^{N}%20\left(\displaystyle%20\frac{1}{2k-1}%20-%20\displaystyle%20\frac{1}{2k}\right)%20-%20\displaystyle%20\sum_{k=1}^{N}%20\left(\displaystyle%20\frac{1}{2k}%20-%20\displaystyle%20\frac{1}{2k+1}\right)\\%20=%20\displaystyle%20\sum_{k=1}^{N}%20\displaystyle%20\frac{1}{2k-1}%20+%20\displaystyle%20\sum_{k=1}^{N}%20\displaystyle%20\frac{1}{2k+1}%20-%20\displaystyle%20\sum_{k=1}^{N}%20\displaystyle%20\frac{1}{k})

%20+%201%20+%20\displaystyle%20\frac{1}{2N+1}%20-%20\displaystyle%20\sum_{k=1}^{N}%20\displaystyle%20\frac{1}{k})

![= 2 \left(\displaystyle \sum_{k=1}^{2N} \displaystyle \frac{1}{k}\right) - 2 \displaystyle \sum_{k=1}^{N} \displaystyle \frac{1}{k} - 2 + 1 + \displaystyle \frac{1}{2N + 1} \\ = 2 \left(\gamma_{2N} +\ln (2N)\right) - 2 \left(\gamma_N + \ln N\right) - 1 + \displaystyle \frac{1}{2N+1} \\ = 2 \gamma_{2N} - 2\gamma_{N} + 2\ln 2 - 1 + \displaystyle \frac{1}{2N+1} \xrightarrow[N \to +\infty]{} 2\ln2-1](http://latex.ilemaths.net/latex-1.tex?=%202%20\left(\displaystyle%20\sum_{k=1}^{2N}%20\displaystyle%20\frac{1}{k}\right)%20-%202%20\displaystyle%20\sum_{k=1}^{N}%20\displaystyle%20\frac{1}{k}%20-%202%20+%201%20+%20\displaystyle%20\frac{1}{2N%20+%201}%20\\%20=%202%20\left(\gamma_{2N}%20+\ln%20(2N)\right)%20-%202%20\left(\gamma_N%20+%20\ln%20N\right)%20-%201%20+%20\displaystyle%20\frac{1}{2N+1}%20\\%20=%202%20\gamma_{2N}%20-%202\gamma_{N}%20+%202\ln%202%20-%201%20+%20\displaystyle%20\frac{1}{2N+1}%20\xrightarrow[N%20\to%20+\infty]{}%202\ln2-1)

On conclut que la méthode des séries entières est plus performante que la méthode directe.

Rappel : La constante d'Euler

On pose : )

Etudions la convergence de la suite ) en introduisant la série téléscopique

en introduisant la série téléscopique  tq :

tq :

-\ln(n)%20\\%20=%20-%20\displaystyle%20\frac{1}{n}%20\displaystyle%20\frac{1}{1%20+%20\frac{1}{n}}%20+%20\ln%20\left(1+\frac{1}{n}\right)%20\\%20=%20-%20\displaystyle%20\frac{1}{n}%20\left(1%20-%20\displaystyle%20\frac{1}{n}%20+%20o%20\left(\displaystyle%20\frac{1}{n}%20\right)%20\right)%20+%20\left(\displaystyle%20\frac{1}{n}%20-%20\displaystyle%20\frac{1}{2n^2}%20+%20o%20\left(\displaystyle%20\frac{1}{n^2}\right)\right)%20\\%20=%20\displaystyle%20\frac{1}{2n^2}%20+%20o%20\left(\displaystyle%20\frac{1}{n^2}\right))

Donc :  .

.

La suite étant réelle,  à partir d'un certain rang

à partir d'un certain rang  (

( est à terme positif à partir du rang

est à terme positif à partir du rang  ) .

) .

Donc :  converge, alors :

converge, alors :  converge.

converge.

On en déduit que : ) converge.

converge.

Définition :

La limite de la suite %20\right)_{n\geq%201}) est appelée la constante d'Euler, on la note

est appelée la constante d'Euler, on la note  .

.

Remarque :

On a :%20-%20\gamma%20=%20o(1)) , d'où :

, d'où : %20+\gamma%20+%20o(1))

V. Développement en série entière (DSE)

1. Généralités

est un intervalle de

est un intervalle de  tq

tq  .

.

Définition :

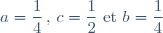

Soit  et

et  tq :

tq :![]-r , r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[%20\subset%20I) .

.

On dit que  est développable en série entière (DSE) sur

est développable en série entière (DSE) sur ![]-r , r[](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[) ssi il existe une série entière

ssi il existe une série entière  de rayon de convergence

de rayon de convergence  tq :

tq : ![\forall x \in ]-r , r[](http://latex.ilemaths.net/latex-2.tex?\forall%20x%20\in%20]-r%20,%20r[) :

: %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) .

.

De manière plus générale si  et si on dit que f est développable en série entière au voisinage de

et si on dit que f est développable en série entière au voisinage de  s'il existe

s'il existe  tel que

tel que ![]x_0 - r , x_0 + r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]x_0%20-%20r%20,%20x_0%20+%20r[%20\subset%20I) et une série entière

et une série entière  de rayon de convergence

de rayon de convergence  tels que

tels que ![\left(\forall x \in]x_0-r,x_0+r[ \right) \quad f(x) = \displaystyle \sum_{n=0}^{+\infty}a_n(x-x_0)^n](http://latex.ilemaths.net/latex-2.tex?\left(\forall%20x%20\in]x_0-r,x_0+r[%20\right)%20\quad%20f(x)%20=%20\displaystyle%20\sum_{n=0}^{+\infty}a_n(x-x_0)^n)

Définition :

Soit  , on dit que

, on dit que  DSE au voisinage de

DSE au voisinage de  ssi il existe

ssi il existe  tq :

tq : ![\left \lbrace \begin{array}{l} ]-r , r[ \subset I \\ f \text{ est DSE sur } ]-r,r[ \\ \end{array}](http://latex.ilemaths.net/latex-2.tex?\left%20\lbrace%20\begin{array}{l}%20]-r%20,%20r[%20\subset%20I%20\\%20f%20\text{%20est%20DSE%20sur%20}%20]-r,r[%20\\%20\end{array})

On note : ) .

.

Exemples :

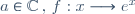

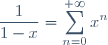

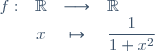

La fonction  est DSE sur

est DSE sur  avec :

avec :  .

.

![\begin{array}{rccl} f : & ]-\infty , 1[ & \longrightarrow & \mathbb{R} \\ & x & \mapsto & \displaystyle \frac{1}{1-x} \\ \end{array}](http://latex.ilemaths.net/latex-1.tex?\begin{array}{rccl}%20f%20:%20&%20]-\infty%20,%201[%20&%20\longrightarrow%20&%20\mathbb{R}%20\\%20%20&%20x%20&%20\mapsto%20&%20\displaystyle%20\frac{1}{1-x}%20\\%20\end{array})

La fonction  est DSE sur

est DSE sur ![]-1 , 1[](http://latex.ilemaths.net/latex-1.tex?]-1%20,%201[) avec :

avec :  .

.

Soit

Soit  ,

,  :

:

est définie sur

est définie sur ![]-|a| , |a|[](http://latex.ilemaths.net/latex-1.tex?]-|a|%20,%20|a|[) .

.

Sur cet intervalle,  est DSE.

est DSE.

En effet, %20=%20\displaystyle%20\frac{1}{a}%20\left(%20\displaystyle%20%20\frac{1}{1%20-%20\displaystyle%20\frac{x}{a}}%20\right))

Or :

D'où : %20=%20\displaystyle%20\frac{1}{a}%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\frac{x}{a}%20\right)^n) , donc :

, donc :  .

.

Soit

Soit  polynômiale de degré

polynômiale de degré  :

:

Alors : %20=%20a_0%20+%20a_1x%20+%20\cdots%20+%20a_px^p) avec

avec  et

et  .

.

En posant  .

.

converge pour tout

converge pour tout  de somme

de somme ) .

.

Toute fonction polynômiale est DSE sur  et elle est son propre développement.

et elle est son propre développement.

Théorème :

Soit  DSE sur

DSE sur ![]-r , r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[%20\subset%20I) avec

avec %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) . Alors :

. Alors :

est de classe

est de classe  sur

sur ![]-r , r[](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[) .

.

}(0)}{n!}) .

.

Exemple :

Soit  ; on a :

; on a :

D'où :  .

.

Si !})

C'est-à-dire : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{x^n}{(n+1)^!}) .

.

Et cela reste vrai pour  ; donc

; donc %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{x^n}{(n+1)^!}) .

.

On conclut que  est DSE sur

est DSE sur  donc

donc  sur

sur  .

.

Corollaire :

Soit  et

et  tq :

tq : ![]-r , r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[%20\subset%20I) .

.

Si  est DSE sur

est DSE sur ![]-r , r[](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[) avec

avec %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) . Alors

. Alors _n) est unique.

est unique.

Exemple :

Soit ![\begin{array}{rccl} f: & ]-1,1[ & \longrightarrow & \mathbb{R} \\ & x & \mapsto & \displaystyle \frac{1}{(1-x^2)(1+x)} \\ \end{array}](http://latex.ilemaths.net/latex-1.tex?\begin{array}{rccl}%20f:%20&%20]-1,1[%20&%20\longrightarrow%20&%20\mathbb{R}%20\\%20%20&%20x%20&%20\mapsto%20&%20\displaystyle%20\frac{1}{(1-x^2)(1+x)}%20\\%20\end{array})

Méthode 1 :

Méthode 1 :

Pour  et

et ^n%20x^n) .

.

D'où, pour %20=%20\left(\displaystyle%20\sum_{n=0}^{+\infty}%20x^{2n}\right)%20\left(\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20x^n%20\right))

%20\left(\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20x^n%20\right)) avec :

avec :

D'où : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\displaystyle%20\sum_{k=0}^{n}%20a_k%20(-1)^{n-k}%20\right)%20x^n%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\displaystyle%20\sum_{k=0}^{E(\frac{n}{2})}%20a_{2k}%20(-1)^{n-2k}%20\right)%20x^n) , pour

, pour

Donc la méthode 1) nous fournit : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20\left(E%20\left(\displaystyle%20\frac{n}{2}%20\right)%20+%201%20\right)%20x^n}) pour

pour  .

.

Méthode 2 :

Méthode 2 :

On a : %20=%20\displaystyle%20\frac{1}{(1-x)(1+x)^2}) et pour

et pour  :

:  .

.

Or, ^2}%20=%20\left(\frac{-1}{x+1}\right)'%20=%20-\left(\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20x^n%20\right)'%20=%20-\displaystyle%20\sum_{n=1}^{+\infty}%20(-1)^{n}%20n%20x^{n-1}%20=\displaystyle%20\sum_{n=1}^{+\infty}%20(-1)^{n+1}%20n%20x^{n-1}) .

.

On obtient : ^2}%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^{n}%20(n+1)%20x^{n}) .

.

%20=%20\left(%20\displaystyle%20\sum_{n=0}^{+\infty}x^n%20\right)%20\left(\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^{n}%20(n+1)%20x^{n}%20\right))

Donc la méthode 2) nous fournit : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\displaystyle%20\sum_{n=0}^{n}%20(-1)^{k}%20(k+1)%20\right)%20x^{n}}) .

.

Méthode 3 :

Méthode 3 :

Décomposons  en fractions rationnelles :

en fractions rationnelles : %20=%20\displaystyle%20\frac{a}{1-x}%20+%20\displaystyle%20\frac{b}{1+x}%20+%20\displaystyle%20\frac{c}{(1+x)^2})

On obtient par calcul :

%20%20=%20%201%20%20=%20a%20+%20b%20+%20c%20\right))

%20=%20\displaystyle%20\frac{1}{4(1-x)}%20+%20\displaystyle%20\frac{1}{4(1+x)}%20+%20\displaystyle%20\frac{1}{2(1+x)^2}%20\\%20=%20\frac{1}{4}%20\displaystyle%20\sum_{n=0}^{+\infty}%20x^n%20+%20\displaystyle%20%20\frac{1}{4}%20\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20x^n%20+%20\displaystyle%20%20\frac{1}{2}%20\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20(n+1)x^n%20\\%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{1+(-1)^n+2(-1)^n(n+1)}{4}%20x^n%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20%20\frac{1+(-1)^n(2n+3)}{4}%20x^n) .

.

La méthode nous fournit : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{1+(-1)^n(2n+3)}{4}%20x^n})

Par unicité du DSE sur ![]-1 , 1[](http://latex.ilemaths.net/latex-1.tex?]-1%20,%201[) , on a :

, on a : ^n%20\left(E%20\left(\displaystyle%20\frac{n}{2}%20\right)%20+%201\right)%20=%20\displaystyle%20\sum_{k=0}^n%20(-1)^k%20(k+1)%20=%20\displaystyle%20\frac{1+(-1)^n(2n+3)}{4}})

Définiton :

Soit  de classe

de classe  .

.

La série entière }%20(0)%20}{n!}%20x^n) est appelée la série de Taylor de

est appelée la série de Taylor de  .

.

2. Techniques de calcul de DSE au voisinage de 0

Il existe plusieurs méthodes de calcul d'un DSE d'une fonction, nous citerons ici les plus utilisées, mais cela ne veut pas dire qu'elles sont les seules, on peut très bien avoir affaire à d'autres méthodes.

Notations et vocabulaire :

Si

Si %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) (avec

(avec  ) est un DSE sur

) est un DSE sur ![]-r , r[](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[) alors le rayon de convergence de la série entière

alors le rayon de convergence de la série entière  est appelé le rayon de convergence du DSE de

est appelé le rayon de convergence du DSE de  .

.

Le plus grand intervalle ouvert

Le plus grand intervalle ouvert ![]-r , r[](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[) sur lequel ce développement est valable s'appelle le domaine de validité du DSE de

sur lequel ce développement est valable s'appelle le domaine de validité du DSE de  , on le note

, on le note  .

.

Remarque :

en général. (Avec

en général. (Avec  est le domaine de validité d'un DSE de

est le domaine de validité d'un DSE de  ).

).

Contre exemple :

on a :

on a : ![D_v = ]-1 , 1[](http://latex.ilemaths.net/latex-1.tex?D_v%20=%20]-1%20,%201[) et

et  .

.

Technique 1 : Utilisation des opérations sur les séries entières

Supposons : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) ,

,  et

et %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20b_n%20x^n) ,

,

En posant ) , on a :

, on a :

:

: %20+%20\eta%20g(x)%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\lambda%20a_n%20+%20\eta%20b_n%20\right)%20x^n) ;

;  pour

pour  .

.

%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left(\displaystyle%20\sum_{k=0}^{n}%20a_k%20b_{n-k}%20\right)%20x^n) ;

;  pour

pour  .

.

Donc toute combinaison linéaire (resp. produit) de deux fonctions DSE(0) est une fonction DSE(0).

Exemples :

%20\text{%20et%20}%20x%20\longrightarrow%20sh(x)) :

:

On a : %20=%20\frac{e^x+e^{-x}}{2})

De plus :  donc :

donc : ^n}{n!}%20x^n)

Alors : ^n}{2}%20\frac{x^n}{n!}%20\,%20\,%20\forall%20x%20\in%20\mathbb{R})

Donc : !}%20\,%20,%20\,%20x%20\in%20\mathbb{R}})

De même : !}%20\,%20,%20\,%20x%20\in%20\mathbb{R}})

:

:

On a : %20=%20\displaystyle%20\frac{e^{ix}+e^{-ix}}{2}) :

:

On a :  et

et ^n%20x^n}{n!})

Alors : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{i^n%20+(-i)^n}{2}%20\displaystyle%20\frac{x^n}{n!}%20=%20\displaystyle%20\sum_{n=0}^{+\infty}i^{2n}%20\displaystyle%20\frac{x^{2n}}{2n!}) .

.

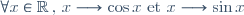

On conclut : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20\displaystyle%20\frac{x^{2n}}{(2n)!}%20\,%20,%20\,%20x%20\in%20\mathbb{R}})

De même : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20(-1)^n%20\displaystyle%20\frac{x^{2n+1}}{(2n+1)!}%20\,%20,%20\,%20%20x%20\in%20\mathbb{R}})

Technique 2 : Méthode de la dérivation et intégration

Soit  dérivable tq

dérivable tq  admet un DSE sur

admet un DSE sur ![]-r , r[ \subset I](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[%20\subset%20I) donné par :

donné par : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) .

.

Alors : ![\displaystyle \int_{0}^x f'(t)dt = \displaystyle \sum_{n=0}^{+\infty} \displaystyle \frac{a_n}{n+1} x^{n+1} \, , \, \forall x \in ]-r , r[](http://latex.ilemaths.net/latex-1.tex?\displaystyle%20\int_{0}^x%20f'(t)dt%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{a_n}{n+1}%20x^{n+1}%20\,%20,%20\,%20\forall%20x%20\in%20]-r%20,%20r[) .

.

D'où, ![\forall x \in ]-r , r[ \, : \, f(x) = f(0) + \displaystyle \sum_{n=0}^{+\infty} \displaystyle \frac{a_n}{n+1}x^{n+1}](http://latex.ilemaths.net/latex-1.tex?\forall%20x%20\in%20]-r%20,%20r[%20\,%20:%20\,%20f(x)%20=%20f(0)%20+%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{a_n}{n+1}x^{n+1}) .

.

Exemples :

![\begin{array}{rccl} f : & ]-1 , +\infty[ & \longrightarrow & \mathbb{R} \\ & x & \mapsto & \ln(1+x) \\ \end{array}](http://latex.ilemaths.net/latex-1.tex?\begin{array}{rccl}%20f%20:%20&%20]-1%20,%20+\infty[%20&%20\longrightarrow%20&%20\mathbb{R}%20\\%20%20%20&%20x%20&%20\mapsto%20&%20\ln(1+x)%20\\%20\end{array})

est dérivable et

est dérivable et ![f'(x) = \displaystyle \frac{1}{1+x} \, \forall x \in ]-1 , +\infty[](http://latex.ilemaths.net/latex-1.tex?f'(x)%20=%20\displaystyle%20\frac{1}{1+x}%20\,%20\forall%20x%20\in%20]-1%20,%20+\infty[) .

.

Or ^n%20x^n) pour tout

pour tout  tq :

tq :  .

.

D'où : %20=%20f(0)%20+%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{(-1)^n}{n+1}%20x^{n+1}) avec

avec  .

.

C'est-à-dire : %20=%20\displaystyle%20\sum_{n=1}^{+\infty}%20\displaystyle%20\frac{(-1)^{n-1}%20x^n}{n}%20\,%20,%20\,%20|x|%20%3C%201}) .

.

\\%20\end{array})

est dérivable sur

est dérivable sur  et

et %20=%20\displaystyle%20\frac{1}{1+x^2}) .

.

On a : ^n%20x^{2n}) avec

avec  .

.

D'où : %20=%20f(0)%20+%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{(-1)^n}{2n+1}%20%20x^{2n+1})

Donc : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20\displaystyle%20\frac{(-1)^n}{2n+1}%20x^{2n+1}%20\,%20,%20\,%20|x|%20%3C%201}) .

.

Technique 3 : Utilisation d'une équation differentielle linéaire

On considère l'équation différentielle linéaire d'ordre  :

:

%20:%20y^{(n)}%20+%20a_{n-1}(x)%20y^{(n-1)}%20+\cdots%20+%20a_0(x)%20y%20=%20b(x)) où :

où : ) .

.

Etant donné  et

et  , on admet qu'il existe une unique solution

, on admet qu'il existe une unique solution  de

de ) sur

sur  tq :

tq :

%20&%20=%20&%20c_0%20\\%20\psi%20'(x_0)%20&%20=%20&%20c_1\\%20\vdots%20&%20&%20\\%20\psi^{(n-1)}(x_0)%20&%20=%20&%20c_{n-1}%20\\%20\end{array}%20\right%20\rbrace)

Soit  de classe

de classe  .

.

Si on détermine toutes les solutions de ) , DSE(0) et si l'une d'elle,

, DSE(0) et si l'une d'elle,  , vérifie :

, vérifie :

%20&%20=%20&%20f(0)%20\\%20\psi%20'(0)%20&%20=%20&%20f'(0)%20\\%20\vdots%20&%20&%20\\%20\psi^{(n-1)}(0)%20&%20=%20&%20f^{(n-1)}(0)%20\\%20\end{array}%20\right%20\rbrace)

Alors  , d'où

, d'où  est DSE(0).

est DSE(0).

Dans la pratique, on se contentera du cas où les fonctions  sont rationnelles.

sont rationnelles.

Exemple :

![\begin{array}{rccl} f : & ]-1 , +\infty[ & \longrightarrow& \mathbb{C} \\ & x & \mapsto & (1+x)^a \\ \end{array} (a \in \mathbb{C} \backslash \mathbb{Z} )](http://latex.ilemaths.net/latex-1.tex?%20\begin{array}{rccl}%20f%20:%20&%20]-1%20,%20+\infty[%20&%20\longrightarrow&%20\mathbb{C}%20\\%20%20&%20x%20&%20\mapsto%20&%20(1+x)^a%20\\%20\end{array}%20(a%20\in%20\mathbb{C}%20\backslash%20\mathbb{Z}%20))

est dérivable et

est dérivable et %20=%20a(1%20+%20x)^{a%20-%201}) .

.

f'(x)%20=%20a(1%20+%20x)^a%20=%20af(x))

est donc solution sur

est donc solution sur ![]-1 , +\infty[](http://latex.ilemaths.net/latex-1.tex?]-1%20,%20+\infty[) de l'équation différentielle

de l'équation différentielle %20:%20(1+x)y'%20-%20ay%20=%200%20\Longleftrightarrow%20y'%20-%20\displaystyle%20\frac{a}{x+1}%20y%20=%200) .

.

Soit ![r \in ]0 , 1]](http://latex.ilemaths.net/latex-1.tex?r%20\in%20]0%20,%201]) , soit

, soit ![\psi : ]-r , r[ \longrightarrow \mathbb{C}](http://latex.ilemaths.net/latex-1.tex?\psi%20:%20]-r%20,%20r[%20\longrightarrow%20\mathbb{C}) de classe

de classe  et DSE sur

et DSE sur ![]-r , r[](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[) .

.

Posons : %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^{n}) avec

avec  .

.

%20=%20\displaystyle%20\sum_{n=1}^{+\infty}%20n%20a_nx^{n-1}) .

.

On a :

est solution de

est solution de ) sur

sur ![]-r , r[](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[)

![\Longleftrightarrow \, \forall x \in ]-r , r[ \, : \, (1 + x) \displaystyle \sum_{n=1}^{+\infty} n a_n x^{n-1} - a \displaystyle \sum_{n=0}^{+\infty} a_n x^n = 0](http://latex.ilemaths.net/latex-1.tex?\Longleftrightarrow%20\,%20\forall%20x%20\in%20]-r%20,%20r[%20\,%20:%20\,%20(1%20+%20x)%20\displaystyle%20\sum_{n=1}^{+\infty}%20n%20a_n%20x^{n-1}%20-%20a%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n%20=%200)

![\Longleftrightarrow \, \forall x \in ]-r , r[ \, : \, \displaystyle \sum_{n=1}^{+\infty} na_n x^{n-1} + \displaystyle \sum_{n=1}^{+\infty} n a_n x^n - a \displaystyle \sum_{n=0}^{+\infty} a_n x^n = 0 \\ \Longleftrightarrow \, \forall x \in ]-r , r[ \, : \, \displaystyle \sum_{n=0}^{+\infty} (n+1)a_{n+1} x^n + \displaystyle \sum_{n=1}^{+\infty} n a_n x^n - a\displaystyle \sum_{n=0}^{+\infty} a_n x^n = 0 \\ \Longleftrightarrow \forall x \in ]-r , r[ \, : \, \displaystyle \sum_{n=0}^{+\infty} \left[(n + 1) a_{n+1} - (a - n)a_n \right] x^n = 0](http://latex.ilemaths.net/latex-1.tex?\Longleftrightarrow%20\,%20\forall%20x%20\in%20]-r%20,%20r[%20\,%20:%20\,%20\displaystyle%20\sum_{n=1}^{+\infty}%20na_n%20x^{n-1}%20+%20\displaystyle%20\sum_{n=1}^{+\infty}%20n%20a_n%20x^n%20-%20a%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n%20=%200%20\\%20\Longleftrightarrow%20\,%20\forall%20x%20\in%20]-r%20,%20r[%20\,%20:%20\,%20\displaystyle%20\sum_{n=0}^{+\infty}%20(n+1)a_{n+1}%20x^n%20+%20\displaystyle%20\sum_{n=1}^{+\infty}%20n%20a_n%20x^n%20-%20a\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n%20=%200%20\\%20\Longleftrightarrow%20\forall%20x%20\in%20]-r%20,%20r[%20\,%20:%20\,%20\displaystyle%20\sum_{n=0}^{+\infty}%20\left[(n%20+%201)%20a_{n+1}%20-%20(a%20-%20n)a_n%20\right]%20x^n%20=%200) .

.

Par unicité du DSE sur ![]-r , r[](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[) de la fonction nulle.

de la fonction nulle.

est solution de

est solution de ) sur

sur ![]-r , r[ \, \Longleftrightarrow \, \forall n \in \mathbb{N} \, : \, a_{n+1} = \displaystyle \frac{a-n}{n+1} a_n \, \, (*)](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[%20\,%20\Longleftrightarrow%20\,%20\forall%20n%20\in%20\mathbb{N}%20\,%20:%20\,%20a_{n+1}%20=%20\displaystyle%20\frac{a-n}{n+1}%20a_n%20\,%20\,%20(*))

Remarque :

Formellement :  . On pouvait donc prendre

. On pouvait donc prendre  .

.

%20\,%20\Longleftrightarrow%20\,%20\forall%20n%20\in%20\mathbb{N}^*%20\,%20:%20\,%20a_n%20=%20\displaystyle%20\frac{a(a-1)%20\cdots%20(a-n+1)}{n!}%20a_0%20=%20{{a}\choose%20{n}}%20a_0)

est solution de

est solution de ) sur

sur ![]-r , r[ \, \Longleftrightarrow \, \forall x\in]-r , r[ \, : \, \psi(x) = a_0 \displaystyle \sum_{n=0}^{+\infty} {a\choose n} x^n](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[%20\,%20\Longleftrightarrow%20\,%20\forall%20x\in]-r%20,%20r[%20\,%20:%20\,%20\psi(x)%20=%20a_0%20\displaystyle%20\sum_{n=0}^{+\infty}%20{a\choose%20n}%20x^n)

Or, %20=%20f(0)%20\,%20\Longleftrightarrow%20\,%20a_0%20=%201) .

.

On a donc trouvé le DSE de  sur

sur ![]-r , r[](http://latex.ilemaths.net/latex-1.tex?]-r%20,%20r[) et qui est :

et qui est : ^a%20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20{a\choose%20n}%20x^n})

Prérequis : Suites et séries de fonctions.

I. Définitions

Étant donné une suite

Étant donné une suite

Une série entière de coefficients

II. Convergence d'une série entière

1. Rayon de convergence

Lemme d'Abel :

Soit  une série entière et

une série entière et  tq

tq _n) est bornée.

est bornée.

Alors, pour tout on a :

on a :  entraîne

entraîne  converge absolument.

converge absolument.

Alors, pour tout

Théorème - Définition :

Soit  une série entière. Alors il existe un unique nombre noté

une série entière. Alors il existe un unique nombre noté  avec

avec  tq :

tq :

s'appelle le rayon de convergence de

s'appelle le rayon de convergence de  .

.

Exemple :

Pour

Pour

Donc

Proposition :

Soit  une série entière de rayon de convergence

une série entière de rayon de convergence  . Alors :

. Alors :

%20\text{%20born%E9e%20}%20\rbrace) .

.

.

.

.

.

![R = \sup_{\bar{\mathbb{R}}} \lbrace |z| / z \in \mathbb{K} \text{ et } a_nz^n \xrightarrow[n \to +\infty]{} 0 \rbrace](http://latex.ilemaths.net/latex-2.tex?R%20=%20\sup_{\bar{\mathbb{R}}}%20\lbrace%20%20|z|%20%20/%20z%20\in%20\mathbb{K}%20\text{%20et%20}%20a_nz^n%20\xrightarrow[n%20\to%20+\infty]{}%200%20\rbrace) .

.

%20\text{%20converge%20}%20\rbrace) .

.

Notation et vocabulaire :

Soit

En particulier, si

Remarques :

1) Si

2) Si

Ou :

Alors :

Proposition :

Soit  et

et  deux séries entières de rayon de convergence

deux séries entières de rayon de convergence  respectivement.

respectivement.

Si , alors :

, alors :  .

.

Si

Proposition :

Soit  et

et  deux séries entières de rayon de convergence

deux séries entières de rayon de convergence  respectivement.

respectivement.

S'il existe tq :

tq :  , alors :

, alors :  .

.

S'il existe

Proposition :

Soit  une fonction rationnelle n'ayant pas de pôles entiers. Alors le rayon de convergence de

une fonction rationnelle n'ayant pas de pôles entiers. Alors le rayon de convergence de z^n) est égal à 1.

est égal à 1.

Remarque :

L'utilisation de la règle de D'Alembert est pratique surtout pour les séries entières dites lacunaires :

C'est-à-dire les séries de la forme

Exemple :

Pour

Si

Si  Si

Si On déduit que

Proposition :

Soit  une série entière, soit

une série entière, soit  (resp.

(resp.  resp.

resp.  ) le rayon de convergence de

) le rayon de convergence de  (resp.

(resp.  et

et  ). Alors

). Alors ) .

.

De plus : .

.

De plus :

Exemple :

On en déduit que

Proposition :

Soit  une série entière de rayon de convergence

une série entière de rayon de convergence  , soit

, soit  une fonction rationnelle n'ayant pas de pôles dans

une fonction rationnelle n'ayant pas de pôles dans  .

.

Alors le rayon de convergence de%20a_n%20z^n) est égal à

est égal à  .

.

Alors le rayon de convergence de

2. Convergence ponctuelle

Théorème :

Soit  une série entière de rayon de convergence

une série entière de rayon de convergence  .

.

Alors converge normalement sur tout compact inclus dans

converge normalement sur tout compact inclus dans )

Alors

Remarque :

Il se peut qu'une série entière de rayon de convergence positif ne converge pas normalement sur le disque

Corollaire :

La somme d'une série entière de rayon de convergence positif est continue sur le disque ) .

.

III. Opérations sur les séries entières

Soit

Soit  Soit

Soit  On pose :

On pose :  On note

On note i)

ii)

iii)

IV. Propriétés de la somme d'une série entière de la variable réelle

Ici,

Théorème :

La série entière  est de rayon de convergence

est de rayon de convergence

De plus, on a :

Remarque :

Soit

Autrement dit :

On dit qu'une série entière s'intègre terme à terme entre deux points quelconques de son intervalle de convergence .

Théorème :

Pour tout

Pour tout

Exemple :

Soit

On a :

Donc :

et puisque

Donc :

Remarque :

On avait obtenu :

Donc :

Essayons de démontrer ce résultat directement en étudiant la somme partielle de la série :

Soit

On conclut que la méthode des séries entières est plus performante que la méthode directe.

Rappel : La constante d'Euler

On pose :

Etudions la convergence de la suite

Donc :

La suite étant réelle,

Donc :

On en déduit que :

Définition :

La limite de la suite %20\right)_{n\geq%201}) est appelée la constante d'Euler, on la note

est appelée la constante d'Euler, on la note  .

.

Remarque :

On a :

V. Développement en série entière (DSE)

1. Généralités

Définition :

Soit  et

et  tq :

tq :![]-r , r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[%20\subset%20I) .

.

On dit que est développable en série entière (DSE) sur

est développable en série entière (DSE) sur ![]-r , r[](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[) ssi il existe une série entière

ssi il existe une série entière  de rayon de convergence

de rayon de convergence  tq :

tq : ![\forall x \in ]-r , r[](http://latex.ilemaths.net/latex-2.tex?\forall%20x%20\in%20]-r%20,%20r[) :

: %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) .

.

De manière plus générale si et si on dit que f est développable en série entière au voisinage de

et si on dit que f est développable en série entière au voisinage de  s'il existe

s'il existe  tel que

tel que ![]x_0 - r , x_0 + r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]x_0%20-%20r%20,%20x_0%20+%20r[%20\subset%20I) et une série entière

et une série entière  de rayon de convergence

de rayon de convergence  tels que

tels que ![\left(\forall x \in]x_0-r,x_0+r[ \right) \quad f(x) = \displaystyle \sum_{n=0}^{+\infty}a_n(x-x_0)^n](http://latex.ilemaths.net/latex-2.tex?\left(\forall%20x%20\in]x_0-r,x_0+r[%20\right)%20\quad%20f(x)%20=%20\displaystyle%20\sum_{n=0}^{+\infty}a_n(x-x_0)^n)

On dit que

De manière plus générale si

Définition :

Soit  , on dit que

, on dit que  DSE au voisinage de

DSE au voisinage de  ssi il existe

ssi il existe  tq :

tq : ![\left \lbrace \begin{array}{l} ]-r , r[ \subset I \\ f \text{ est DSE sur } ]-r,r[ \\ \end{array}](http://latex.ilemaths.net/latex-2.tex?\left%20\lbrace%20\begin{array}{l}%20]-r%20,%20r[%20\subset%20I%20\\%20f%20\text{%20est%20DSE%20sur%20}%20]-r,r[%20\\%20\end{array})

On note :) .

.

On note :

Exemples :

La fonction

La fonction

Soit

Soit Sur cet intervalle,

En effet,

Or :

D'où :

Soit

Soit Alors :

En posant

Toute fonction polynômiale est DSE sur

Théorème :

Soit  DSE sur

DSE sur ![]-r , r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[%20\subset%20I) avec

avec %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) . Alors :

. Alors :

est de classe

est de classe  sur

sur ![]-r , r[](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[) .

.

}(0)}{n!}) .

.

Exemple :

Soit

D'où :

Si

C'est-à-dire :

Et cela reste vrai pour

On conclut que

Corollaire :

Soit  et

et  tq :

tq : ![]-r , r[ \subset I](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[%20\subset%20I) .

.

Si est DSE sur

est DSE sur ![]-r , r[](http://latex.ilemaths.net/latex-2.tex?]-r%20,%20r[) avec

avec %20=%20\displaystyle%20\sum_{n=0}^{+\infty}%20a_n%20x^n) . Alors

. Alors _n) est unique.

est unique.

Si

Exemple :

Soit

Méthode 1 :

Méthode 1 : Pour

D'où, pour

D'où :

Donc la méthode 1) nous fournit :

Méthode 2 :

Méthode 2 : On a :

Or,

On obtient :

Donc la méthode 2) nous fournit :

Méthode 3 :

Méthode 3 : Décomposons

On obtient par calcul :

La méthode nous fournit :

Par unicité du DSE sur

Définiton :

Soit  de classe

de classe  .

.

La série entière}%20(0)%20}{n!}%20x^n) est appelée la série de Taylor de

est appelée la série de Taylor de  .

.

La série entière

2. Techniques de calcul de DSE au voisinage de 0

Il existe plusieurs méthodes de calcul d'un DSE d'une fonction, nous citerons ici les plus utilisées, mais cela ne veut pas dire qu'elles sont les seules, on peut très bien avoir affaire à d'autres méthodes.Notations et vocabulaire :

Si

Si  Le plus grand intervalle ouvert

Le plus grand intervalle ouvert Remarque :

Contre exemple :

Technique 1 : Utilisation des opérations sur les séries entières

Supposons :En posant

Donc toute combinaison linéaire (resp. produit) de deux fonctions DSE(0) est une fonction DSE(0).

Exemples :

On a :

De plus :

Alors :

Donc :

De même :

On a :

On a :

Alors :

On conclut :

De même :

Technique 2 : Méthode de la dérivation et intégration

SoitAlors :

D'où,

Exemples :

Or

D'où :

C'est-à-dire :

On a :

D'où :

Donc :

Technique 3 : Utilisation d'une équation differentielle linéaire

On considère l'équation différentielle linéaire d'ordreEtant donné

Soit

Si on détermine toutes les solutions de

Alors

Dans la pratique, on se contentera du cas où les fonctions

Exemple :

Soit

Posons :

On a :

Par unicité du DSE sur

Remarque :

Formellement :

Or,

On a donc trouvé le DSE de

Suites numériques

I. L'ensemble des suites réelles

1. Définition d'une suite

On appelle suite réelle toute application d'une partie de  à valeurs dans

à valeurs dans  et on note

et on note _{n}) ou

ou _{n}) en général.

en général.

Vocabulaire : L'ensemble des suites réelles sera noté par

2. Opérations algébriques

a) Egalité

Soient ) et

et %20\;%20\in%20\mathbb{R}^{\mathbb{N}}) .

.

On dit que les suites sont égales et on note :%20=%20(V_{n})) ssi :

ssi : %20:%20U_{n}=V_{n})

On dit que les suites sont égales et on note :

Exemple :

On a

b) Addition

Soient ) et

et %20\in%20\mathbb{R}^{\mathbb{N}}) .

.

La suite%20\in%20\mathbb{R}^{\mathbb{N}}) définie par :

définie par :  est appelée la suite somme de

est appelée la suite somme de ) et

et ) et on note :

et on note : %20=%20(U_n+V_n)) .

.

Exemple : La suite

On a donc :

c) Produit

Soient ) et

et )

, la suite

, la suite %20\in%20\mathbb{R}^{\mathbb{N}}) définie par :

définie par :  est appelée la suite produit de

est appelée la suite produit de ) et

et ) et on note :

et on note : %20=%20(U_n.V_n))

Exemple : On a :

d) Produit par un scalaire

Soit %20\in%20\mathbb{R}^{\mathbb{N}}) et soit

et soit  , la suite

, la suite ) définie par :

définie par :  sera noté :

sera noté : )

3. Suite minorée - majorée - bornée

Définition :

Soit

On dit que

On dit que

Puisque

Alors

Proposition :

Soit

4. Suite croissante - décroissante - monotone

Définition :

Soit

Soit

Soit

Donc

II. Notions de suites convergentes

1. Définition et propriétés de la convergence

Définitions :

Soit

On dit que

Si une suite ne converge pas, on dit alors qu'elle diverge.

Théorème :

Si la suite

Proposition :

Toute suite convergente est bornée.

La réciproque est fausse en général.

Exemple :

Soit

2. Opérations sur les limites

Théorème :

Soient

Soient

La suite

Si

Théorème :

Soient

Si

3. Convergence des suites monotones

Théorème fondamental :

Soit

Soit

Corollaire :

Toute suite croissante négative est convergente.

Toute suite décroissante positive est convergente.

Définition :

Soit

On dit que

Proposition :

Soit

Si

Si

Proposition :

Soient

Si

Si

III. Suites extraites - Suites adjacentes

1. Suites extraites

Définition :

Soient

Soit

Proposition :

Soit

Proposition :

Toute suite extraite d'une suite bornée est bornée.

Toute suite extraite d'une suite convergente est convergente et converge vers la même limite.

Alors si on trouve que deux suites extraites ne convergent pas vers la même limite, alors la suite "mère" n'est pas convergente (diverge).

Théorème de Bolzano - Weierstrass réel :

De toute suite réelle bornée on peut extraire une suite convergente.

2. Suites adjacentes

Définition :

Soient

Proposition :

Soient

Théorème :

Deux suites adjacentes sont convergentes et convergent vers la même limite.

IV. Suite de Segments Emboités

Définitions :

Un segment est tout intervalle fermé et borné de la forme

Soit

Soit

Proposition :

Soit

Théorème des segments emboités :

Soit

V. Suites récurrentes

1. Suite arithmético-géométrique

Définition :

Soit

Si

Proposition :

2. Suites récurrentes linéaires du 2e ordre

Définition :

Soit

est appelée suite recurrente linéaire du 2e ordre, et l'équation

Théorème :

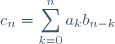

Soit

- Si

: l'équation admet 2 racines réelles

et

tq :

avec

.

- Si

: l'équation admet une racine double réelle

tq :

avec

.

- Si

: l'équation admet deux racines conjuguées :

et

tq :

avec

.

3. Suite recurrente : cas général

Définition :

Soit

est appelé suite recurrente.

VI. Suites Complexes

Définition :

Une suite complexe est toute application d'une partie de

1. Soit

2. Tous les résultats dans

Proposition :

Soit

Proposition :

Soit

Théorème de Bolzano - Weierstrass complexe :

De toute suite complexe bornée on peut extraire une suite convergente.

Inscription à :

Articles (Atom)